当前位置 :首页>新闻动态

近日,南方科技大学王中锐副教授团队的5篇顶会论文被国际设计自动化领域顶级会议DAC2025录用,南科大为第一通讯单位。DAC(设计自动化会议,Design Automation Conference)是集成电路芯片设计与辅助工具研究领域的国际顶级会议,也是电子设计自动化领域的CCF-A类会议,至今已有62年历史。2025年的DAC会议将于6月22日至25日在美国加利福尼亚州旧金山的Moscone West会展中心举行。

随着人工智能技术的快速发展,深度神经网络(DNN)在自动驾驶、医疗保健和金融等领域的应用越来越广泛。然而,DNN加速器的安全性和能效提升问题日益凸显。王中锐课题组针对这两个重要问题,主要完成了以下工作:

论文一:《Re4PUF: A Reliable, Reconfigurable ReRAM-based PUF Resilient to DNN and Side Channel Attacks》

作者信息:Ning Lin, Yi Li, Yangu He, Songqi Wang, Hegan Chen, Kwunhang Wong, Chuxin Li, Jichang Yang, Yifei Yu, Meng Xu, Yongkang Han, Rui Chen, Xiaoming Chen, Xiaoxin Xu, Jianguo Yang, Dashan Shang and Zhongrui Wang

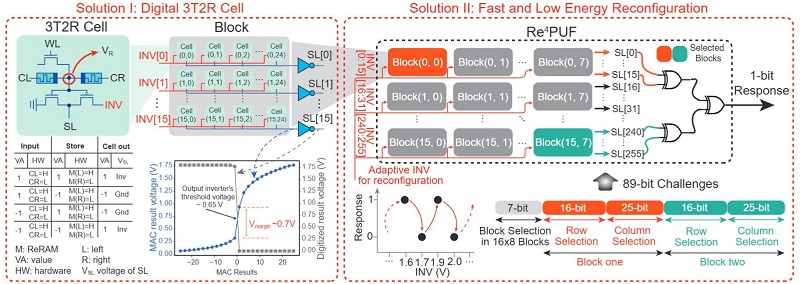

基于忆阻器(ReRAM)的物理不可克隆函数(PUF)因其低能耗和紧凑尺寸的优势,已成为一种具有研究和应用前景的硬件安全原语。然而,现有的基于ReRAM的PUF的可靠性会受到环境的影响,同时也面临深度神经网络建模攻击和侧信道攻击(SCA)的威胁。本文提出了一种新型的3T2R ReRAM可重构PUF(见图1),通过数字3T2R的分压单元设计,提高了基于ReRAM的PUF可靠性。通过调节反相器的供电电压,使PUF无需重擦写ReRAM即可快速、低成本地实现重构,从而防御DNN建模和SCA的威胁。

图1:Re4PUF整体设计

论文二:《Guarder: A Stable and Lightweight Reconfigurable RRAM-based PIM Accelerator for DNN IP Protection》

作者信息:Ning Lin, Yi Li, Jiankun Li, Jichang Yang, Yangu He, Yukui Luo, Dashan Shang, Xiaoming Chen, Xiaojuan Qi and Zhongrui Wang

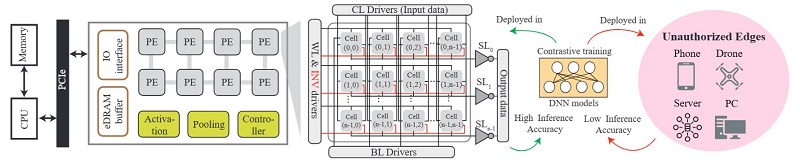

深度神经网络模型部署在基于忆阻器的存算芯片中存在模型安全问题。这是由于忆阻器的非易失性特点,使得断电情况下攻击者依然可以读取权值。为此,我们提出软硬件协同设计解决方案(见图2)。硬件方面,我们利用3T2R设计的可重构功能来实现模型的加密。这种可重构使得芯片在不同的密钥下具有不同的前向推理结果。软件方面,我们提出一种差异化对比训练方法,确保在授权芯片上模型具有较高的前向推理性能,而在未授权芯片上前向推理性能很低。在图像分类、分割以及生成任务上的大量实验验证了我们方法的有效性。我们的方法确保模型在授权芯片上几乎没有性能下降,而在未授权芯片上的性能降至随机猜测或生成。

图2:Guarder整体设计

论文三:《SeDA: Secure and Efficient DNN Accelerators with Hardware/Software Synergy》

作者信息:Wei Xuan, Zhongrui Wang, Lang Feng, Ning Lin, Zihao Xuan, Rongliang Fu, Tsung-Yi Ho, Yuzhong Jiao and Luhong Liang

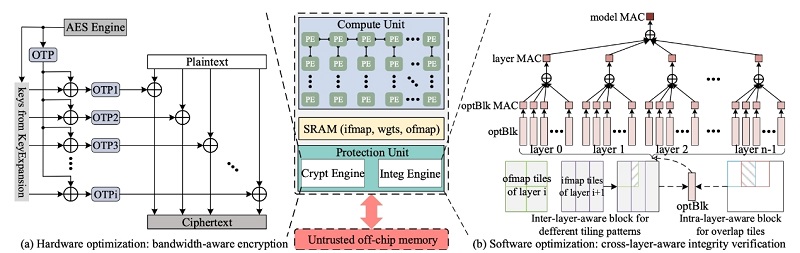

近年来安全DNN加速器备受关注。该研究提出了一种硬件和软件的协同优化机制,实现了高安全性和高效率的DNN加速器设计(见图3)。其核心创新包括:1)带宽感知加密机制,采用单个AES引擎并结合密钥扩展模块生成多个独特的一次性密码,从而在不增加硬件资源的情况下满足高带宽需求,防止了单元素碰撞攻击,并降低了硬件开销。2)多级完整性验证机制,引入了基于块、层和模型的多粒度完整性验证,减少了安全元数据的存储和访问需求,通过将层或模型粒度的安全元数据存储在加速器芯片内,几乎消除了对内存的额外访问开销,同时防止了重新排列攻击。3)还考虑了DNN模型中层内和层间的数据块对齐问题,避免了冗余的加密和解密操作,进一步提高了性能。

图3:SeDA整体设计

论文四:《Efficient Edge Vision Transformer Accelerator with Decoupled Chunk Attention and Hybrid Computing-In-Memory》

作者信息:Yi Li, Zijian Ye, Xiangqu Fu, Songqi Wang, Shucheng Du, Ning Lin, Dashan Shang, Jinshan Yue, Zhongrui Wang, Xiaojuan Qi, Feng Zhang and Han Wang

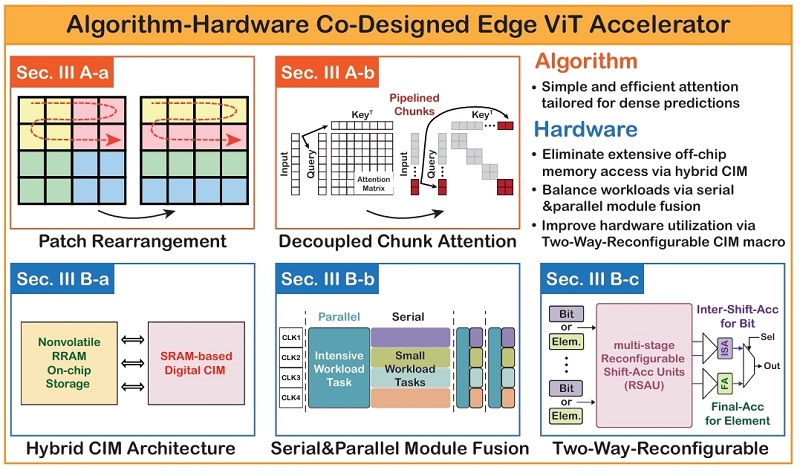

在DNN加速方面,该研究提出一种基于算法-硬件协同优化的边缘视觉Transformer加速器(见图4),旨在解决现有ViT模型在边缘设备上部署时面临的高计算复杂度、资源消耗大以及硬件利用率低等问题。通过算法层面的解耦分块注意力机制,采用流水线方式减少片外内存访问,实现有限片上内存下的高效密集预测;在架构层面,引入基于SRAM的存内计算与非易失性RRAM存储的混合架构,结合融合调度策略,平衡工作负载并减少中间片上内存访问;在电路层面,提出双向可重构的CIM宏单元,提升硬件利用率。该研究为边缘设备上的高能效、低延迟密集预测提供了创新解决方案,推动ViT在自动驾驶和监控图像分析等领域的广泛应用。

图4:边缘端ViT整体设计

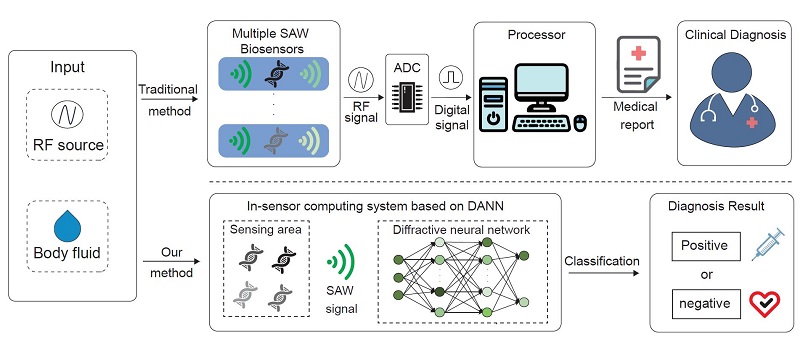

论文五:《DANN: Diffractive Acoustic Neural Network for in-sensor computing system target at multi-biomarker diagnosis》

作者信息:Lewei He, Ning Lin, Binbin Cui, Xinran Zhang, Shiming Zhang and Zhongrui Wang

对于声学系统的加速,该研究提出一种基于衍射声学系统的模拟机器学习硬件,以及对应的仿真方法,旨在突破传统光学生物传感在液体环境进行即时检测的瓶颈(见图5)。通过将AI算法与声学传感器集成,系统直接在模拟域处理微流控生物信号,避免模数转换延迟及冯·诺依曼瓶颈,显著提升能效与实时性。研究聚焦于声学组件的小型化优化,克服光学系统在微流道内难以压缩的缺陷,为便携式医疗设备提供高精度、低成本的即时分子检测方案,推动边缘AI在床边诊断中的应用。

图5:DANN系统整体设计